Ефремов в роли всех «Ангелов Чарли»: моушн-дизайнер добавляет русских актёров в голливудские фильмы с помощью DeepFake Статьи редакции

Моушн-дизайнер Андрей Чаушеску из Волгограда создал трейлер «Ангелов Чарли», в котором роли всех спецагентов исполняет Михаил Ефремов. До этого он смонтировал трейлер «Терминатора 2» с Александром Невским. Оба ролика сделаны с помощью технологии DeepFake. TJ поговорил с автором о производстве видео и источниках вдохновения.

Андрей рассказал, что на основной работе занимается производством видео, поэтому в качестве хобби решил изучать дипфейки. Для трейлера ремейка «Ангелов Чарли» он выбрал именно Ефремова ради «элемента неожиданности»: «Это прикольно, потому что они никак не ассоциируются между собой».

Сначала Андрей хотел создать целое трио с Ефремовым, Сергеем Гармашом и Алексеем Серебряковым в ролях «Ангелов», чтобы «наконец-то увидеть актёров вместе на одном экране, использовать их сложившиеся образы в неожиданном ключе и добавить максимальный неподходящий для них жанр женского шпионского боевика». Но на это ушло бы намного больше усилий.

Андрей отметил, что на производство роликов и без того уходит много времени. На дипфейк с Ефремовым он потратил более четырёх недель: «Процесс тренировки нейросети — очень долгий и требует контроля. Особенно для видео с кучей разных планов, сцен и действий».

В качественных дипфейках лица накладывают в рамках одной сцены с постоянным светом, когда человек находится в одинаковом положении. Я почему-то выбрал трейлер, в котором средний кадр длится 3 секунды. Это была ошибка, но надеюсь это и выглядит интереснее, хотя бы идейно.

До Ефремова Андрей создал тестовое видео про «Терминатора». Он хотел проверить свои силы и, недолго думая, решил воплотить «самую банальную идею для дипфейка в российском интернете» — совместить российского актёра и режиссёра Александра Невского с его кумиром Арнольдом Шварценеггером. Автор признался, что в этом ролике больше всего ему нравится финальная сцена с блогером BadComedian, который обозревал несколько фильмов Невского.

На создание таких дипфейков Андрея вдохновили работы «Ctrl Shift Face»: «Cамые качественные и интересные работы делает именно он». Этот канал набрал популярность в мае, после ролика, в котором лицо Билла Хейдера заменили на Арнольда Шварценеггера. Среди его последних известных видео — дипфейки с Илоном Маском.

Вообще вставка других актеров в фильмы стала визитной карточкой дипфейков. Например, в 2018 году в соцсетях были популярны ролики с Николасом Кейджем в любых картинах мира.

Андрей пообещал развивать свой канал, если заметит позитивную реакцию на ролики с российскими актёрами: «Потенциал, мне кажется, гигантский».

Обновлено в 17:33: Михаил Ефремов прокомментировал радио «Говорит Москва» дипфейк с его участием: «Это такая прикольная нелепица. Прикольно сделали, только не понятно зачем».

6 лучших Deepfake приложений и инструментов в 2021 году

Различные методы манипулирования изображениями были введены в 19 веке и позднее применялись к кинофильмам. Эти методы быстро улучшились с цифровым видео.

В начале 1990-х годов исследователи из академических институтов разработали технологию Deepfake, которая впоследствии была доработана разработчиками в онлайн-сообществах. В последнее время подделки Deepfake привлекают большое внимание за их использование в финансовых махинациях, розыгрышах и фальшивых новостях.

Это заставило правительство и промышленность выявлять и ограничивать их незаконное использование. Тем не менее технология имеет большой потенциал, если ее правильно использовать.

Что такое технология Deepfake?

Deepfakes относятся к манипулируемому визуальному контенту, генерируемому сложным искусственным интеллектом, который дает сфабрикованные изображения и звуки, которые кажутся реальными. В большинстве случаев, человек в существующем видео или изображении заменяется на чье-то подобие.

Хотя трудно создать хороший deepfake на обычном компьютере, есть много инструментов, доступных в интернете, чтобы помочь людям сделать достойные deepfakes. Технология все еще находится в зачаточном состоянии, поэтому не ожидайте идеального результата.

Мы тщательно собрали несколько хороших deepfake приложений и инструментов, которые не требуют высокого класса рабочего стола с мощными графическими картами (за исключением одного или двух). Вы можете использовать их как в исследовательских целях, так и просто для развлечения, но не нарушайте чью-либо частную жизнь.

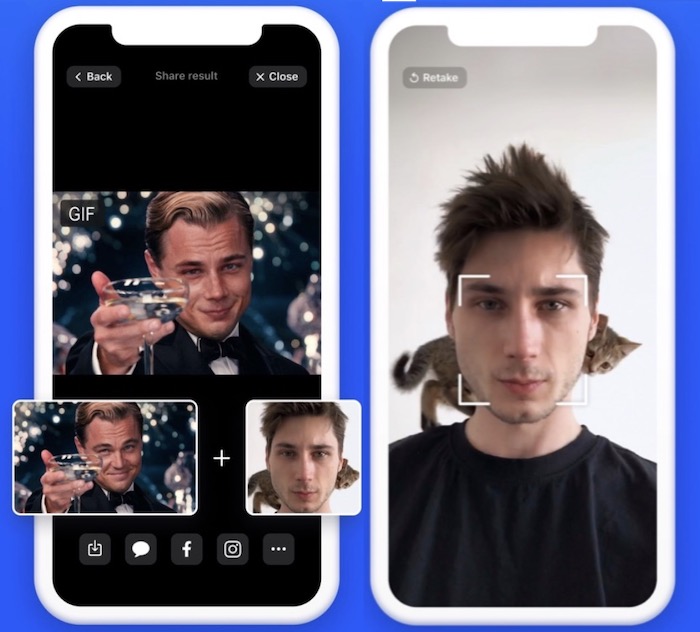

6. Doublicat

Платформа: Android / iOS

Цена: Бесплатно

Doublicat позволяет вам сделать селфи и поместить свое лицо на мем или GIF в своей библиотеке. Это займет около 5 секунд, чтобы ваше лицо было наложено на лицо Брэда Питта, Леонардо Ди Каприо или Тейлора Свифта.

Вы будете удивлены, увидев, насколько хорошо ваше наложенное лицо принимает те же выражения, что и оригинал. Вы можете переслать результаты своей семье и друзьям или опубликовать их в Instagram.

Вывод будет довольно странным, если будет много движений лица, но в целом это интересный эксперимент. По словам разработчиков приложения, само изображение удаляется с серверов сразу после его обработки. Однако при этом сохраняется представление черт лица.

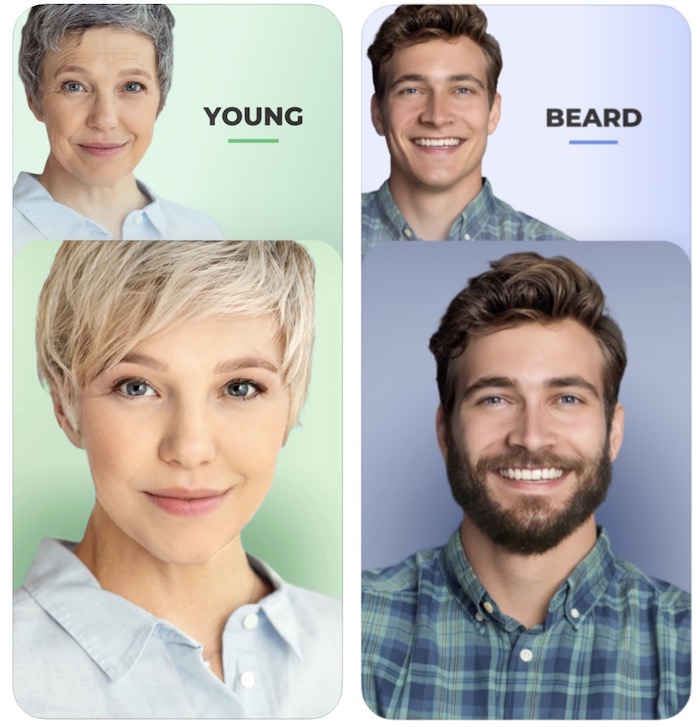

5. FaceApp

Платформа: Android / iOS

Цена: Бесплатно

FaceApp разработан российской компанией Wireless Lab. Он использует нейронные сети для генерации высокореалистичных преобразований лиц на фотографиях.

Приложение может преобразить ваше лицо, чтобы заставить его улыбаться, выглядеть старше, выглядеть моложе или просто смены пола, а также многих других захватывающих преобразований. Татуировки, виньетки, размытие объектива и наложение фона также являются частью FaceApp.

В 2018 году приложение привлекло много внимания со стороны трансгендерных и ЛГБТ-сообществ из-за его реалистичных преобразований гендерных изменений. Он также столкнулся с критикой как в социальных сетях, так и в прессе за конфиденциальность пользовательских данных.

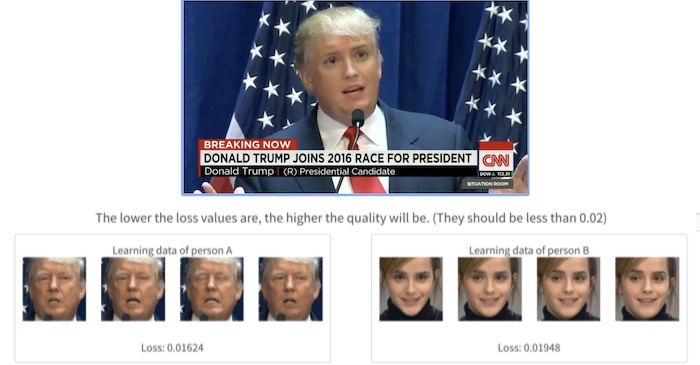

4. Deepfakes web β

С помощью этого инструмента вы можете создавать deepfake видео в интернете. Однако кривая обучения здесь немного больше, чем то, что вы найдете в других приложениях.

Вам нужно зарегистрироваться и загрузить свои видео. Все остальное происходит в облаке, где используются мощные графические процессоры. На изучение видео/изображений и смену лиц уходит почти 4 часа. Вы также можете использовать обученную модель, чтобы менять лица, что занимает около 30 минут.

Качество выходного видео зависит от значений «потерь»: чем ниже значения потерь (при обучении из загруженных видео), тем выше качество. И, конечно, только вы можете получить доступ к своим видео и учебным данным.

3. DeepFaceLab

Платформа: Windows

Цена: Бесплатный

DeepFaceLab является ведущим программным обеспечением для создания подделок. Она использует новые нейронные сети для замены лиц в видео. Она размещена на GitHub и породила бесчисленное множество видео в интернете.

По словам его разработчиков, более 95% глубоких подделок видео создаются с помощью DeepFaceLab. Его используют несколько популярных каналов YouTube, таких, как Ctrl Shift Face, iFake и Shamook.

DeepFaceLab прекрасно работает, но для его использования необходимы технические знания. Как только вы загрузите и разархивируете инструмент, вы увидите множество папок и ряд командных файлов. Существует папка с именем «workspace», которая содержит все обучающие модели, исходные видео и выходные данные. Инструмент работает с определенными именами и местоположениями файлов, чтобы пакетный файл мог функционировать.

2. FaceSwap

Платформа: Windows | MacOS | Linux

Цена: бесплатно

FaceSwap похож на DeepFaceLab, но предоставляет больше возможностей, лучшую документацию и лучшую онлайн-поддержку. И да, он также доступен на Mac и Linux.

Это инструмент с открытым исходным кодом, наполненный функциональностью для выполнения каждого шага процесса Deepfake, от импорта первоначального видео до создания финального видео Deepfake. Чтобы запустить этот инструмент, вам нужна мощная видеокарта, так как замена лица происходит невероятно медленно.

Работая на Python, Keras и Tensorflow, Faceswap имеет активное сообщество, поддерживающее и разрабатывающее программное обеспечение. Есть много учебников, которые помогут вам начать работу.

1. Zao

Платформа: Android | iOS

Цена: бесплатно

Технология глубокой подделки Zao позволяет вам модулировать голоса знаменитостей и накладывать свое лицо на тело актера в сцене.

Просто нажмите на одну фотографию и попробуйте тысячи модных причесок, одежды и макияжа. Приложение предоставляет вам множество видеоклипов, нарядов и буквально неограниченные возможности для изучения.

В 2019 году Zao за короткое время приобрел значительную популярность, позволив пользователям обмениваться лицами с любимыми актерами в коротких клипах из телепередач и фильмов. За месяц он стал самым загружаемым бесплатным приложением в Китае. С ростом популярности, его разработчики также столкнулись с критикой политики конфиденциальности приложения.

Это займет всего несколько секунд, чтобы поменять ваше лицо, но так как алгоритм в основном обучен на китайских лицах, это может выглядеть не так естественно, как вы ожидаете.

Тем не менее все эти инструменты демонстрируют, как быстро развивался базовый ИИ: то, что раньше требовало тысячи картинок, чтобы сделать достаточно убедительное глубокое поддельное видео, теперь требует только одного изображения и дает лучшие результаты.

Cложно ли сделать deepfake-видео и можно ли бороться со злоумышленниками, если использовали лицо для поддельного ролика Статьи редакции

Коротко о том, что нужно для deepfake, и борьбе платформ с ложными фото и видео.

18 января проект «Вкладер» рассказал, что мошенники выпустили два deepfake-видео с рекламой супердоходов, скопировав лицо основателя Flocktory и Dbrain Дмитрия Мацкевича. В рекламе его копия приглашает на инвестиционные мастер-классы с обещанием 360% годовых.

Сам же Мацкевич считает, что это «крутое иммерсивное шоу про будущее ИИ, которое уже наступило» и один из первых коммерческих примеров использования deepfake, которых в будущем будет всё больше.

Существуют открытые и бесплатные нейросетевые приложения с технологией deepfake, которые можно использовать для замены лиц и создания видео с нужным человеком в «главной роли». Самые популярные открытые библиотеки — faceswap и DeepFaceLab.

DeepFaceLab позволяет заменить лицо, голову и возраст человека на видео, а также оптимизировать движение губ под нужные слова. Для работы нужен компьютер с мощной видеокартой и большим объёмом видеопамяти, исходное видео с лицом-источником и целевое видео, на которое будет накладываться нужное лицо.

Процесс создания deepface-видео через DeepFaceLab в упрощённом виде:

Обучение модели нейросети — самая ресурсоёмкая задача, от которой зависит качество deepfake. Чем дольше тренируется нейросеть и чем лучше исходники, тем качественнее получится.

В целом, хотя работа над deepfake и занимает несколько десятков часов, она не требует особых навыков. Достаточно иметь мощный компьютер и время для экспериментов по созданию маски, выбору модели нейросети и её обучения.

Юридически deepfake-видео не нарушают законов, из-за новизны они находятся в «серой зоне» ответственности, писал The Verge. В России нет законов, регулирующих deepfake.

Перед выборами президента США в 2020 году интернет-платформы обновили правила: во многом запретили использование и публикацию deepfake-видео, а также начали разработку алгоритмов по их определению.

Но пожаловаться на deepfake можно не везде:

Версия: никакой проблемы в таких «фейках» нет. Это одно из качеств современного мира. Тебя могут «подделать», в любом виде. Это значит, что нужно учиться воспринимать не «факты»(именно факты можно подделать), а законы или принципы, по которым производятся эти факты. Еще это можно назвать «стиль».

Представьте, что если такой «фейк» сделали на вашу «маму»(например) какие будут ваши действия? Скорее всего вы скажите, что «это не она, она не могла так сказать/сделать», и пойдёте дальше. То есть вы очень Хорошо знаете свою «маму», но если разбираться, а что это значит, выяснится, что вы знаете буквально ее «стиль». И вы примерно предполагаете что она может сказать, а что нет. То есть все сказанное, вы как будто пропускаете сквозь такой «фильтр-стиль», который становится для вас критерием истины, а не те факты, которые вам предлагаются. И только факты прошедшие этот фильтр имеют право на жизнь.

Это тот мир, в котором мы уже живем. И жизнь в этом мире требует мыслительных усилий. Именно это качество поделит мир на «элиту» и «массы».

Прежде чем официально кидать предьяву, полагая, что именно ваше лицо было использовано в дипфейке помните: там мог сниматься атер/актрисса очень похожий на вас. И в этом случае получите обратный иск от него по набору статей.

Ну,, тут-то хотя бы не врите. Вынесите этот «набор статей» на обозрение, поржём.

Или как М.Видео и Эльдорадо продаёт вам витринные образцы за полную цену.

Дипфейк с русскими актрисами

Датчане из коллектива DiepNep сделали прекрасное видео с Морганом Фрименом. Вот только это совсем не он, а дипфейк. Имитация с помощью современных нейросетей. Даже голос идеально сделан. Ироничный текст, где он спрашивает, что такое реальность. Сделал перевод!

Я хотел бы поприветствовать вас в эпоху синтетической реальности.

Что ты видишь теперь?

Что нас ждет лет через 5, когда такие штуки научатся делать не группы программистов-энтузиастов, а приложения на телефоне?

p.s. нашел у них на фейсбук, что голос таки сделала не нейросеть, а некий Boet Schouwink

вот цитата «Freeman’s voice imitation is done by the incredibly talented Boet Schouwink.»

p.p.s. знаю что боян, но в других постах текста не было, только сам видос

2 кадра

Все скидки и промокоды в одном месте

Вы там как, готовы к осенним распродажам? Чтобы не пропустить самые интересные и выгодные предложения, подпишитесь на полезный телеграм-канал Пикабу со скидками. Да, Пикабу не только для отдыха и мемов, но и для экономных покупок!

В «Пикабу Скидки» вы найдете актуальные предложения:

• доставки еды (KFC, Delivery Club, «Папа Джонс»);

• книги («Читай-город», «Литрес», Storytel);

• услуги и сервисы («Делимобиль», Boxberry, «Достависта»);

• маркетплейсы и гипермаркеты (Ozon, «Ашан», «Яндекс.Маркет»);

• одежда и обувь (Adidas, ASOS, Tom Tailor)

• бытовая техника и электроника («М.Видео», «Связной», re:Store);

• товары для дома (IKEA, «Леруа Мерлен», Askona);

• косметика и парфюмерия («Л’Этуаль», «Иль де Ботэ», Krasotka Pro);

• товары для детей («Детский мир», MyToys, Mothercare);

• образование («Нетология», GeekBrains, SkillFactory);

• и еще куча-куча всего.

Deepfake Джим Керри в роли Джеймса Бонда)

Эйс Вентура на службе Её Величества)

Неплохой грим для 1989 года. Некоторые зрители даже предпочитают его дипфейку.

Британский стартап выпустил программу, позволяющую изменять мимику актеров в кино. Так, чтобы она совпадала с дубляжом

Британская компания Flawless выпустила программу TrueSync, которая с помощью машинного обучения синхронизирует дубляж с мимикой актеров. Это значит, что движения губ и лицевых мышц людей на экране будут совпадать с тем, что говорят актеры озвучания. Нейросети сами проанализируют мимику актеров и подстроят под дубляж, заменив их лица на дипфейк. Выглядеть это будет так, будто, к примеру, Роберт Де Ниро изначально во время съемок произносил свои реплики на немецком, а не на английском, как показано в проморолике TrueSync.

Просто взгляните, как это выглядит:

Назад в прошлое

Лицо Марти Макфлая в гриме, изображающем возраст 47 лет и его реальное лицо в возрасте 52 лет:

В Китае с помощью сгенерированных изображений аферисты набрали невозвратных кредитов на десятки миллионов долларов

В Китае новый вид мошенничества, который только набирает обороты, но уже позволил похитить из банков десятки миллионов долларов. Виной всему цифровой прогресс.

Популярнейшая технология распознавания лиц, которую глубоко внедрили во все сферы жизни, дала пищу аферистам. Вопрос, который их волновал «а что если для получения кредита использовать несуществующее случайно сгенерированное лицо», ответ был найден быстро.

Старая как мир история: некто обманул государство на десятки миллионов долларов. Но дело не в том, что обманул, а в том, как обманул. Аферисты обогатились, взломав легендарную китайскую систему распознавания лиц. Власти делятся информацией неохотно: Китай стал первым государством, пострадавшим от монстра, которого сам породил.

Системы распознавания лиц здесь повсюду. Чтобы войти в банк, офис или просто во двор, часто не нужны документы, достаточно лица. Система его считает даже в маске, дверь откроется автоматически.

Если есть система, то всегда найдутся желающие ее взломать. Китайский интернет наводнен роликами, где граждане пытаются открыть замки, подставив под око камеры фотографии вместо лиц. Но замки — это детский лепет. Есть более серьезные вещи: технология Face ID в Китае вовсю используется для подтверждения банковских операций и оплате налогов. Этим, уже по-взрослому, и воспользовались аферисты.

– Они создали большое количество автоматически сгенерированных нейронной сетью несуществующих фотографий лиц несуществующих людей. И с помощью технологии дипфейк они смогли их оживить и создать для них несуществующие счета. На протяжении нескольких лет они смогли получить кредиты и в общей сложности около ста миллионов долларов они смогли украсть. Это первое злоупотребление такого рода технологиями, – комментирует Олег Кивокурцев, директор компании по производству сервисных роботов.

Что такое технология дипфейк? Говоря простым языком, это возможность с помощью нехитрых компьютерных манипуляций создать одно лицо из другого. Или заставить, скажем, известных китайских мужчин петь женским голосом. Или даже научить петь кота.

Подобными приложениями активно балуются пользователи соцсетей. Но то забавы ради. Другое дело, когда инструмент попадает в руки людей с дурными намерениями. В США женщина применила технологию дипфейк, чтобы скомпрометировать конкуренток своей дочери, девушек из группы поддержки одной из спортивных команд. Она рассылала интимные видео якобы с их участием. Все было настолько реалистично, что подделку распознала только полиция. И таких случаев все больше.

Китайцев возможность манипуляций с фото и видео беспокоит давно, уже больше года за такое предусмотрена уголовная ответственность, а на местном телевидении один за другим выходят репортажи, как уберечься от мошенников. Имидж еще ладно, но как сохранить деньги?

– С точки зрения противодействия самый, на мой взгляд, эффективный метод – это так называемая двухэтапная идентификация, когда помимо того, что есть изображение, вы подтверждаете действия либо цифровым кодом, либо смс ответным, ну то есть, чтобы ваши операции, связанные с деньгами, предполагала минимум два действия, потому что если вы оставите только одно действие, ну, например, там не знаю, скан с отпечатками пальцев или изображение, то мошенники, используя вот эту методику, могут ее обойти, – говорит Дмитрий Смиркин, IT-специалист.

Все происходящее, конечно, сильный аргумент в пользу того, чтобы держать платежные пароли только в голове, а важные данные записывать от руки на бумажку и класть в сейф. Но прогресс остановить невозможно. Цифровые технологии будут с нами, хотим мы того или нет. Тем важнее наша собственная осмотрительность.

Как делают deepfake-видео и почему лучше говорить «face swap»

Рассказываем о работе технологии face swap, создании известных сегодня deepfake-видео, как трансфер лиц поможет медиарынку и в каком направлении развивается эта область машинного обучения.

Каждый день из многочисленных Telegram-каналов, изданий об ИТ прилетают новости о создании алгоритмов, работающих над преобразованием контента.

Недавно компания Тимура Бекмамбетова и разработчики робота «Вера» придумали технологию синтеза голосов знаменитостей. Учёные из МФТИ научили компьютер воспроизводить изображения, которые видит человек в данный момент, а компания OpenAI создала алгоритм, пишущий почти осмысленный текст на основе минимальных исходных данных.

Нейросети оперируют и видеоконтентом: генерируют движущиеся пейзажи, убирают объекты или же заставляют танцевать людей на фото.

Сложнее обстоят дела с трансфером человеческих лиц или тел на изображениях. Эту сферу начинают осваивать стартапы, которые создают продукты для оптимизации процессов производства контента: Dowell (проект компании Everypixel Group, Россия), Synthesia (Великобритания), а также RefaceAI — создатели приложений Doublicat и Reflect (Украина).

Есть несколько сервисов вроде Reflect, Doublicat или Morhine, которые работают в реальном времени со статичным форматами или GIF. Недавно китайские разработчики зашли на поле видеоформата и выпустили приложение Zao, которое встраивает лица пользователей в известные фильмы.

В остальном широкая аудитория остаётся непричастной к созданию такого контента и потребляет deepfake-видео, которые выпускают известные продакшн-студии или свободные художники на YouTube.

Существуют разные архитектуры алгоритмов, которые переносят лица с видео на видео. Мы расскажем о нескольких самых распространённых.

Метод перемещения лица, в основе которого — кодировщик и декодировщик. Работает это так:

Один из распространённых кодов для переноса лиц таким методом написал российский разработчик-энтузиаст Иван Перов. В его репозитории DeepFaceLab на GitHub есть подробнейшие руководства с комментариями, системные требования к оборудованию и программному обеспечению и даже видеоинструкция.

В подходе с использованием этого метода улучшить результат можно только вручную, корректируя базы данных перед обучением или на постпродакшене.

Поэтому всё чаще в архитектуру с кодировщиком и декодировщиком вплетаются генеративно-состязательные сети. Их суть заключается в соревновании генератора и дискриминатора (отсюда — GAN, Generative Adversarial Network, генеративно-состязательная сеть).

Генераторы учатся создавать наиболее реалистичную картинку, дискриминаторы — определять, какая из них сгенерированная, а какая оригинальная. По мере того как генераторы обучаются обманывать дискриминатор, изображение получается всё более реалистичным.

Таким образом, кодировщик и декодировщик отвечают за перенос изображения, а дискриминатор от генеративных сетей — за улучшение результата. По этой логике работает архитектура Face Swap GAN, созданная японским разработчиком Shaoanlu.

Ещё один подход — архитектуры с использованием нескольких генеративно-состязательных сетей. Каждая сеть отвечает за свою операцию, что сводит к минимуму количество этапов с применением ручного труда.

Чтобы обучить такую нейросеть, требуется несколько суток и мощный кластер видеокарт. Несмотря на это, такой подход является наиболее перспективным, потому что даёт лучший результат.

Одно из решений, созданных по этой технологии, — FSGAN, которое в скором времени обещает опубликовать в открытом доступе его создатель, израильский исследователь Юваль Ниркин.

Здесь одна нейросеть учится подгонять лицо донора под параметры целевого видео (поворот головы, наклон вбок или вперёд), вторая переносит черты лица, а третья делает image blending (слияние изображений), чтобы картинка была более реалистичной, без разрывов или артефактов.

Сегодня перенос лиц, если он выполняется исключительно алгоритмами, всё ещё заметен человеческом глазу: выдают либо визуальные артефакты, например мимика или положение глаз, либо непохожесть нового лица ни на реципиента, ни на донора — в результате получается третья сущность.

Гладкий трансфер лиц всё ещё обеспечивают не нейросети, а навыки в CGI (многие широко известные сегодня создатели deepfake-видео вроде Corridor Crew и Ctrl Shift Face правят работу алгоритмов вручную на постпродакшене или же совершают манипуляции перед самим обучением).

Как правится контент до или после обучения нейросети, нам рассказал моушн-дизайнер студии Clan Андрей Чаушеску, который несколько месяцев назад создал нашумевший в России ролик с актёром Михаилом Ефремовым в трейлере фильма «Ангелы Чарли».

Недавно он опубликовал новую работу, поместив в фильм «Великий Гэтсби» изображение актёра Сергея Бурунова, который обычно озвучивает Леонардо Ди Каприо в русском дубляже. Свои проекты Андрей делает в программе DeepFaceLab, поэтому мы будем говорить о правках, которые требуются для работы именно с этим алгоритмом.

На этапе препродакшена проводится работа с данными перед началом обучения нейросети. Когда два видео разложены на наборы кадров, нужно отсмотреть эти базы и обратить внимание на несколько моментов.

Во-первых, не все люди могут обменяться друг с другом лицами незаметно. Сегодня переносимая алгоритмами область — от бровей до подбородка и от уха до уха (то есть уши, лоб и волосы остаются в целевом видео родными). Поэтому на схожесть результата влияют влияют пол, возраст, цвет кожи и волос, а также комплекция и форма лица.

Некоторые студии, делая поддельные видео с известными артистами, ищут максимально похожих на них людей: ребята из Corridor нашли человека, очень похожего на Тома Круза, а актёр, играющий в ролике с Киану Ривзом, надел чёрный парик, чтобы воссоздать образ актера.

Ctrl Shift Face недавно выпустил три ролика с разными актёрами в одной сцене из фильма «Старикам здесь не место». Лучше всего получился Арнольд Шварценеггер, так как форма его головы больше всего подходит под форму актёра Хавьера Бардема, в отличие от Дефо и Ди Каприо.

Во-вторых, если в донорском видео лицо всегда анфас, а в целевом голова поворачивается и виден профиль, алгоритм не перенесёт лицо корректно, потому что не знает, как выглядит человек в профиль. Так же обстоят дела с положением глаз, движением губ, мимикой и эмоциями (смех или плач): оба человека должны побывать в максимально совпадающем диапазоне ситуаций.

Часто нейросеть некорректно распознаёт глаза. Конечно, больше пользы принесёт подбор фотографий с нужным положением глаз, хорошо считываемой мимикой, но «обман» нейросети тоже может дать хороший результат.

После обучения то, что не углядели в начале, и то, в чём оказался бессилен алгоритм, докрашивается на постпродакшене. В ролике с Сергеем Буруновым Андрею пришлось столкнуться с проблемой разной формы лица двух актеров, которую он решал уже на завершающем этапе.

Самый быстрый способ сделать поддельный ролик — наложить лицо, не выходя за рамки головы человека с целевого видео (в данном случае — Ди Каприо). Лицо Бурунова шире, и, как мне кажется, сходство терялось, поэтому приходилось вручную масками прорисовывать его овал.

Основная программа, которой я пользуюсь на постпродакшене, — Adobe After Effects. Я делаю цветокоррекцию, добавляю размытие для имитации движения камеры и шум для эффекта кинопленки.

Отдельная история — работа с изображениями, в которых перед лицом есть искажающая преграда: скафандр, искривлённое зеркало или очки. Тут единственный выход — ПО вроде After Effects, Cinema 4D.

В них вручную создаётся текстура материала, которая затем ставится перед лицом, чтобы выглядело, как в оригинале. Из-за таких ограничений часто бывает, что очень классные сцены фильмов сложно использовать в deepfake-роликах.

Для YouTube-формата, когда каждый вышедший ролик становится информационным поводом и предполагает вау-реакцию аудитории, такой подход применим. Видео можно долго шлифовать, а потом ещё отдельно описывать процесс, как это часто делают в Corridor Crew.

Очевидно, рынок сервисов для пользователей не предполагает какой-либо постпродакшн: результат нужен сейчас. Того же хочет и профессиональная индустрия (кино и реклама), которая руками переносить лица уже умеет, но сейчас фокусируется на удешевлении и автоматизации процесса.

Монетизируется технология face swap по двум стандартным моделям. Для b2c-аудитории создаются развлекательные приложения вроде Zao или Doublicat. Для b2b-аудитории — продукты, которые используются для оптимизации продакшена, маркетинговых коммуникаций, персонализации брендированного контента или в игровой индустрии.

Среди них Dowell и RefaceAI, создатели которых рассказали, по какой логике работает их продукт и какую нишу на рынке они планируют освоить.

Dowell вырос в офисе компании Everypixel Group, которая занимается производством контента и создаёт продукты на основе искусственного интеллекта. Изучив рынок, создатели стартапа поняли, что развитие продуктов для пользователей и демонстрация deppfake-публикаций на YouTube не их путь, и проработали сценарии использования в киноиндустрии и маркетинге.

Один из кейсов они реализовали с BBDO — рекламный ролик с изображением генерального директора крупного автомобильного бренда, в съёмках которого этот человек не принимал непосредственного участия.

Жизненный цикл сервисов, которые позволяют заменять лица, ограничен: пользователи не будут заходить туда каждый день. Это инструмент, который позволяет «пошуметь», рассказать о себе, оседлать волну хайпа. Но мы решили сосредоточиться на решении бизнес-задач.

Во-первых, это маркетинговая коммуникация брендов с аудиторией. Мы создаём персонализированный контент и с помощью видео помогаем обрести их клиентам пользовательский опыт перед покупкой.

Во-вторых, решаем проблему увеличения доходности агентств, работающих со звёздами, их клиентов. Представьте, что Джордж Клуни одновременно снимается в голливудском фильме, рекламном ролике Nespresso и проводит презентацию нового Mercedes в Штутгарте.

В таком формате доступ к «телу» звёзд появится у тех брендов и организаций (вроде благотворительных фондов), которые никогда не могли себе позволить пригласить звезду живьём.

На старте разработки продукта изучение алгоритмов, находящихся в открытом доступе, помогло нам понять логику работы, увидеть слабые места, но зависеть от чужого кода — тупиковый путь. Это чёрный ящик, содержание которого слабо можно представить, результат будет непредсказуемым.

В процессе собственных разработок мы одновременно проводили несколько исследований. Во-первых, искали влияние одних признаков и черт лица на другие, чтобы ими можно было управлять независимо друг от друга, по отдельности переносить глаза, нос, форму лица и губы.

Во-вторых, мы разделяем персону (черты лица) и контент (условия, в которой лицо появляется: свет, сюжет, эмоции), после чего можем взять персону и поместить её в те условия, которые нам нужны.

Чем страдают все открытые алгоритмы, так это маленьким разрешением переносимой области — 256 на 256 пикселей. Продакшн-студии работают с более качественными изображениями, и здесь мы задались целью увеличить область до стороны в 1024 пикселей.

Проблему можно решить, обучив нейросеть наращивать разрешение с 256 до 1024 пикселей и с помощью дискриминатора оценивать, насколько хорошо это получилось сделать. По такому же принципу можно «деблюрить» изображения, делая из размытых чёткие.

Компания RefaceAI, которая исторически занималась анализом текста и генеративными сетями, связанными с автоматической конвертацией 2D-видео в 3D, video inpainting (удаление или восстановление фрагментов на видео), пришла к технологии face swap случайно, получив запрос на модификацию лиц от одной киностудии.

Тогда они решили протестировать гипотезу: насколько востребованным формат станет для обычных пользователей, и сделали сервис Reflect, который создаёт изображения с заменой лиц.

Сейчас команда выводит на рынок второе приложение, Doublicat. Оно будет менять лица на видео (в бета-версии перенос перенос в формате GIF).

В начале мы провели глубокий анализ всех общедоступных решений, которые используются для создания deepfake, поняли фундаментальные недостатки этих подходов, не позволяющие их масштабировать.

Сейчас для тренировки сетей мы используем существующие фреймворки машинного обучения (PyTorch), но основной код полностью создан нашей командой.

Использование нейросетей позволяет нам работать в более абстрактном пространстве, чем пиксели. Мы не занимаемся вырезанием и вставкой лиц, а затем гармонизацией результата, что требует много ручной работы.

Вместо этого мы натренировали нейросеть модифицировать минимальное количество визуальных признаков лица для максимальной схожести с нужным человеком. Она делает это на основе изученного пространства всех возможных черт лиц людей. Таким образом, необходимость в ручной постобработке видео сведена к минимуму.

Что касается приоритетов в разработке трансфера лиц в видео, для b2c-модели сейчас главное — максимально быстрое обучение алгоритма, чтобы сервис работал в режиме реального времени и обучение не занимало долгие часы. Китайское приложение Zao сделало это первым.

Но его слабая сторона — алгоритм работает с предобученными данными. Пользователь не может загрузить свой контент, он загружает туда лишь изображение, которое переносится в заданный разработчиками набор видео.

B2b-решения больше сфокусированы на качестве переноса лиц, схожести результата и увеличении разрешения переносимой области, оптимизации времени обучения. Команда RefaceAI планирует, помимо лиц, освоить перенос туловища.

Часть нашей команды работает над технологией замены всего тела, это будет следующий большой шаг после замены лиц. Технология тоже основана на концепции генеративно-состязательных сетей. Но в замене тела больше вызовов и проблем, которые нужно решить, прежде чем выводить технологию в производство.

Синхронно с развитием технологии встаёт вопрос о риске распространения ложных новостей и их определения. Разработчики RefaceAI одновременно со своими сервисами создают антидоты, помогающие распознать сгенерированные изображения и видео.

Сейчас подделку можно определить по тем частям тела человека, перенос которых не предусмотрен технологией: уши, волосы, лоб. Если эти части тела особенно выдающиеся, определить можно и невооруженным взглядом, но есть базы данных для распознавания ушей. Но очевидно, что когда-то их тоже станут переносить, и этот способ перестанет работать.

Ещё один распространённый инструмент — бинарный классификатор, который учится определять реальные и поддельные изображения. Однако сама логика работы генеративных сетей подразумевает, что такой классификатор обречён оставаться обманутым.

Интересный подход использовал учёный Хао Ли: у каждого человека есть индивидуальные паттерны мимики и движения лица, которые при переносе наследуются от реципиента. Таким образом можно математическим методом вычислить, что лицо донора ведёт себя неестественным для него образом.

У технологии трансфера лиц пока не устоялось одно название, и во многих источниках в пределах одной и той же публикации её могут называть и так, и так (этот текст — не исключение).

Термин «face swap», предположительно, пришёл в язык в 2000-х годах с появлением в графических редакторах функций, которые позволяли пользователям трансформировать лица на изображениях (иногда употребляли термины «face replacement», «face morphing»), а также из научных работ.

Но сфера применения была очень узкой, поэтому в 2017 году, когда интернет взорвали ложные порноролики с участием известных артистов, технологию стали называть deepfake — по нику пользователя Reddit, который эти ролики публиковал. И это слово легко подвинуло термин, которому на тот момент было полтора десятка лет, и стало употребляться наравне с ним.

Противостояние двух определений заключается в том, что первое удобнее для тех, кто стремится вывести технологию в правовое поле и адаптировать к современным реалиям коммуникации. В конце концов спичрайтинг — это тоже своего рода подделка, но никто его так не называет.